Os modelos de IA sempre nos surpreendem, não apenas no que podem fazer, mas também no que não podem e por quê. Um novo comportamento interessante é ao mesmo tempo superficial e revelador sobre estes sistemas: eles escolhem números aleatórios como se fossem seres humanos.

Mas primeiro, o que isso significa? As pessoas não podem escolher um número aleatoriamente? E como saber se alguém está fazendo isso com sucesso ou não? Na verdade, esta é uma limitação muito antiga e bem conhecida que nós, humanos, temos: pensamos demais e entendemos mal a aleatoriedade.

Diga a uma pessoa para prever cara ou coroa para 100 lançamentos de moeda e compare isso com 100 lançamentos de moeda reais – você quase sempre pode diferenciá-los porque, contra-intuitivamente, o verdadeiro lançamento de moeda olhar menos aleatório. Muitas vezes haverá, por exemplo, seis ou sete caras ou coroas seguidas, algo que quase nenhum preditor humano inclui em seus 100.

É a mesma coisa quando você pede a alguém para escolher um número entre 0 e 100. As pessoas quase nunca escolhem 1 ou 100. Múltiplos de 5 são raros, assim como números com dígitos repetidos como 66 e 99. Eles geralmente escolhem números que terminam em 7, geralmente do meio em algum lugar.

Existem inúmeros exemplos desse tipo de previsibilidade na psicologia. Mas isso não torna menos estranho quando as IAs fazem a mesma coisa.

Sim, alguns engenheiros curiosos da Gramener realizaram um experimento informal, mas ainda assim fascinante, em que simplesmente pediram a vários chatbots LLM importantes que escolhessem aleatoriamente um número entre 0 e 100.

Leitor, os resultados foram não aleatório.

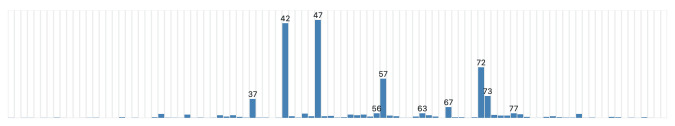

Todos os três modelos testados tinham um número “favorito” que sempre seria sua resposta quando colocados no modo mais determinístico, mas que aparecia com mais frequência mesmo em “temperaturas” mais altas, aumentando a variabilidade de seus resultados.

O GPT-3.5 Turbo da OpenAI realmente gosta de 47. Anteriormente, ele gostava de 42 – um número que ficou famoso, é claro, por Douglas Adams em O Guia do Mochileiro das Galáxias como a resposta para a vida, o universo e tudo mais.

Claude 3 Haiku da Anthropic ficou com 42. E Gêmeos gosta de 72.

O mais interessante é que todos os três modelos demonstraram um viés semelhante ao humano nos números que selecionaram, mesmo em altas temperaturas.

Todos tendiam a evitar números altos e baixos; Claude nunca passou de 87 ou abaixo de 27, e mesmo esses eram valores discrepantes. Os dígitos duplos foram escrupulosamente evitados: não houve 33, 55 ou 66, mas apareceu 77 (termina em 7). Quase nenhum número redondo – embora Gêmeos tenha feito isso uma vez, na temperatura mais alta, enlouqueceu e escolheu 0.

Por que isso deveria acontecer? IAs não são humanas! Por que eles se importariam com o que “parece” aleatório? Eles finalmente alcançaram a consciência e é assim que mostram isso?!

Não. A resposta, como geralmente acontece com essas coisas, é que estamos antropomorfizando um passo longe demais. Esses modelos não se importam com o que é ou não aleatório. Eles não sabem o que é “aleatoriedade”! Eles respondem a essa pergunta da mesma forma que respondem a todo o resto: observando seus dados de treinamento e repetindo o que foi escrito com mais frequência após uma pergunta que parecia “escolha um número aleatório”. Quanto mais aparece, mais frequentemente o modelo o repete.

Onde em seus dados de treinamento eles veriam 100, se quase ninguém responde dessa forma? Pelo que o modelo de IA sabe, 100 não é uma resposta aceitável para essa pergunta. Sem nenhuma capacidade real de raciocínio e sem qualquer compreensão de números, ele só pode responder como o papagaio estocástico que é.

É uma lição prática sobre os hábitos do LLM e a humanidade que eles podem parecer mostrar. Em cada interação com esses sistemas, é preciso ter em mente que eles foram treinados para agir como as pessoas agem, mesmo que essa não fosse a intenção. É por isso pseudontropia é tão difícil de evitar ou prevenir.

Escrevi na manchete que esses modelos “pensam que são pessoas”, mas isso é um pouco enganador. Eles não pensam nada. Mas em suas respostas, em todos os momentos, eles são imitando as pessoas, sem qualquer necessidade de saber ou pensar. Quer você esteja pedindo uma receita de salada de grão de bico, conselhos de investimento ou um número aleatório, o processo é o mesmo. Os resultados parecem humanos porque são humanos, extraídos diretamente de conteúdo produzido por humanos e remixados – para sua conveniência e, claro, para os resultados financeiros da grande IA.