Universidade de Columbia

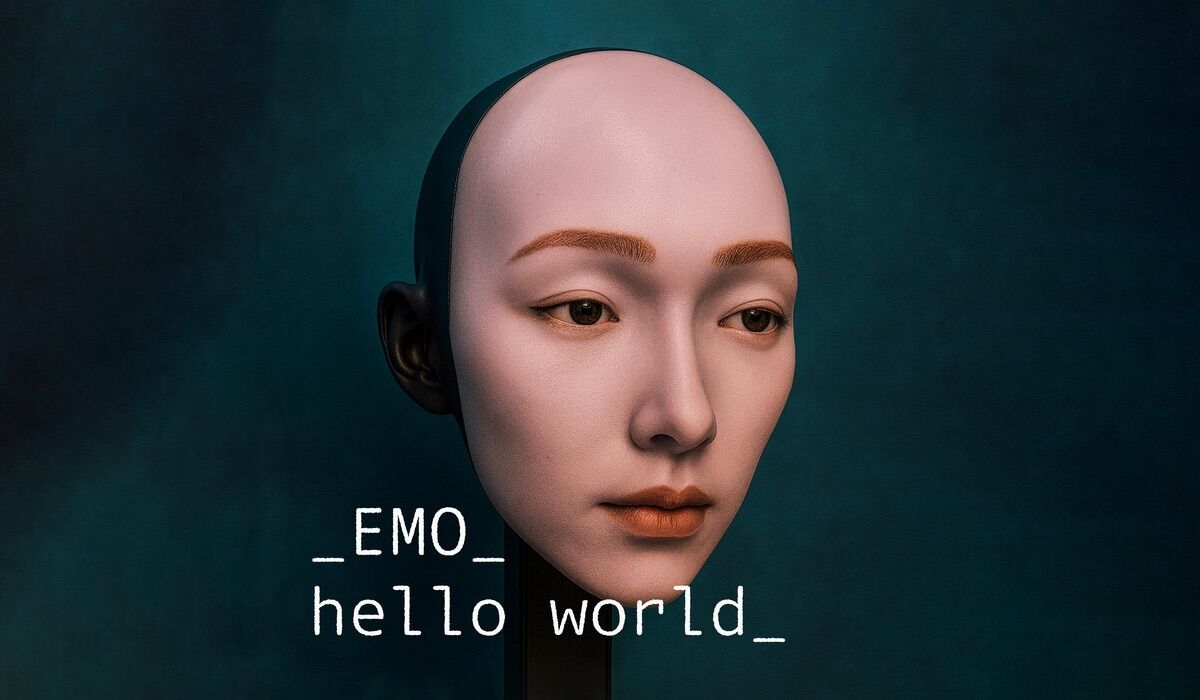

EMO, o robô da Columbia Engineering que faz lip-sync

Investigadores da Universidade de Columbia conceberam um robô capaz de movimentos labiais realistas a falar e cantar. O robô utilizou as suas capacidades para articular palavras e até cantar uma canção do seu álbum de estreia gerado por IA — mas ainda algures no “Uncanny Valley”.

Estudos anteriores demonstraram que a maioria das pessoas se concentra nos movimentos dos lábios durante conversas presenciais.

Contudo, criar robôs que consigam replicar estes movimentos labiais de forma contínua representa um desafio, e mesmo os robôs mais avançados disponíveis no mercado atualmente, quando comunicam, produzem na melhor das hipóteses apenas gestos semelhantes aos de fantoches.

Agora, uma equipa de investigadores da Universidade de Columbia, liderada por Hod Lipson e Sally Scapaestá a produzir robôs que visam superar estas limitações.

Nesta fase, as criações da equipa ainda parecem inanimadas, ou até inquietantesporque as suas expressões faciais não correspondem às expectativas humanas, invocando um fenómeno conhecido como o “Vale Estranho“, algo como “Vale da Estranheza”, em tradução livre — a ligeira estranheza que sentimos perante a representação de um humano que “está quase lá” mas não é perfeita.

O trabalho da equipa, detalhado num estudo publicado na semana passada na revista Robótica Científicarevela como o seu robô utilizou as suas capacidades para articular palavras em diversas línguas e até a cantar uma canção do seu álbum de estreia gerado por IA, “Olá mundo“.

Dentro do Uncanny Valley

Então, o que é exatamente o Uncanny Valley? “É aquela sensação estranha que se tem quando se observa um robô a tentar parecer humanomas a falhar algo essencial”, explica Lipson ao O interrogatório.

“Penso que metade do problema reside no movimento labialporque metade do tempo em que os humanos se envolvem em conversas presenciais, fixam o olhar nos lábios do interlocutor”, afirmou Lipson.

“Até à data, os robôs não têm lábiose a maioria nem sequer tem rosto. O nosso robô EMO está longe de ser perfeito, mas penso que está no caminho para atravessar o vale estranho”, acrescenta.

Ao contrário das abordagens tradicionais, que dependem de programação rígida e regras predefinidas, o robô da equipa de Columbia aprende através da observação de humanos em ação.

Inicialmente, o robô foi concebido para praticar em frente a um espelho, fazendo experiências com os seus 26 músculos faciais para o ajudar a “aprender” como o seu próprio rosto se move.

Uma vez familiarizado com as suas próprias expressões, o robô observou horas de vídeos de humanos a falar e a cantaraprendendo sobre a sincronização exata e a coordenação dos movimentos labiais.

“Não programamos os motores diretamente. Em vez disso, a IA do robô aprende ao longo do tempo como mover os motores observando humanos e depois observando-se a si próprio no espelho, e comparando”, explica Lipson.

Após este treino, o robô demonstrou a capacidade de traduzir áudio diretamente em ação labial-motora sincronizada.

“Os robôs melhoram quanto mais interagem com humanos“, explicou Lipson num comunicado da Columbia Engineering. “Esta abordagem baseada na aprendizagem permite ao robô refinar continuamente as suas expressõestal como uma criança aprende observando e imitando adultos.”

“Os motores faciais do robô estão dispersos sob o rosto do robôe foram concebidos para permitir ao robô fazer uma grande variedade de gestos faciais, incluindo movimento labial, sorrir e outros movimentos”, acrescentou Lipson.

Alcançar este tipo de movimento labial semelhante ao humano requer uma “pele” facial flexível e muitos pequenos motores capazes de movimento rápido e silencioso.

Os padrões intrincados do movimento labial são determinados por sons vocais e fonemasum tipo de coreografia que os humanos utilizam para executar estes movimentos sem esforço através de dezenas de músculos faciais.

Ao combinar um rosto altamente motorizado com um modelo de aprendizagem visão-para-ação, o robô de Columbia supera estes obstáculos: primeiro explorou expressões faciais aleatórias, depois expandiu e refinou a sua capacidade a observar humanos, construindo um modelo que liga pistas auditivas a movimentos motores precisos.

No seu estado atual, a tecnologia ainda requer algumas melhoriascomo indicam os desafios que o robô experimenta ao produzir os sons “B” e “W”. Não obstante, o sistema fez progressos enormes para além das capacidades de fala de outros robôs atualmente no mercado.

“Este é o elo em falta na robótica“, afirmou Lipson. “Grande parte do esforço no desenvolvimento de humanoides concentra-se em andar ou agarrar, mas a expressão facial é essencial para a conexão humana“.